Introduction

« Celui qui croit qu'une croissance exponentielle peut continuer indéfiniment dans un monde fini est soit fou, soit un économiste. »

Kenneth E. Boulding (1910-1993)

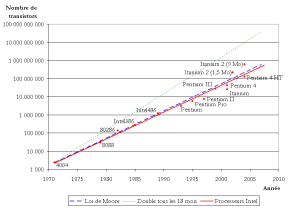

La loi de Moore a joué un rôle important dans l'histoire de l'informatique. Formulée pour la première fois par Gordon E. Moore dans un article de 1965, elle postule le doublement annuel des performances des circuits intégrés (mémoires et processeurs). Cette annonce a incité les ingénieurs à concevoir des systèmes très en avance sur les possibilités du jour de leur conception. Elle a ainsi contribué à accélérer le rythme de l'innovation.

Moore a revu son estimation en 1975 : le doublement aurait lieu tous les 18 mois et non tous les ans, ce qui correspond tout de même à une croissance très rapide. Cette "loi", fondée sur un constat empirique, a été vérifiée par la suite. Moore estime qu'elle se poursuivra jusqu'aux environs de 2017, date à laquelle elle devrait rencontrer des contraintes physiques.

Sur le graphique ci-contre, regardez bien l'échelle de l'axe verticale... On l'appelle échelle logarithmique.

Croissance du nombre de transistors dans les microprocesseurs Intel par rapport à la loi de Moore. En vert, la prédiction initiale voulant que ce nombre double tous les 18 mois

Cette loi illustre bien la notion de croissance exponentielle et la manière dont elle se heurtera à des limites dans un monde qui n'est pas infini. Elle montre également comment cette croissance exponentielle a été un moteur de développement et d'innovations, poussant les ingénieurs et développeurs à réaliser des systèmes en avances sur les capacités technologiques de leur époque.